「AI新青年讲座」由智东西公开课出品,致力于邀请青年学者,主讲他们在生成式AI、LLM、计算机视觉、机器学习等人工智能领域的最新重要研究成果。

AI新青年是加速人工智能前沿研究的新生力量。AI新青年的视频讲解和直播答疑,将可以帮助大家增进对人工智能前沿研究的理解,相应领域的专业知识也能够得以积累加深。同时,通过与AI新青年的直接交流,大家在AI学习和应用AI的过程中遇到的问题,也能够尽快解决。

7月起,AI 新青年讲座开辟推出「大型语言模型专场」。阿卜杜拉国王科技大学在读博士朱德尧、新加坡国立大学在读博士薛复昭、美国威斯康星大学麦迪逊分校在读博士柳昊天和加州大学伯克利分校人工智能实验室(BAIR)在读博士张天均将参与此次专场。

四位 AI 新青年将分别针对 MiniGPT-4、LLaVA、Gorilla,以及大型语言模型所面临的 Token 危机进行直播讲解。

近来,大型语言模型备受关注,ChatGPT 和 GPT-4 都展现了非常令人吃惊的能力,在聊天对话、数学推理和代码生成等方面尤为显著。但 LLM 依然受限于一个固定的权重集内可存储的信息以及它们可使用一个静态的计算图(computation graph)和有限上下文所能计算的东西。在通过 API 调用使用工具时,它们无法生成准确的输入参数,并且容易产生错误的API调用用法幻觉。

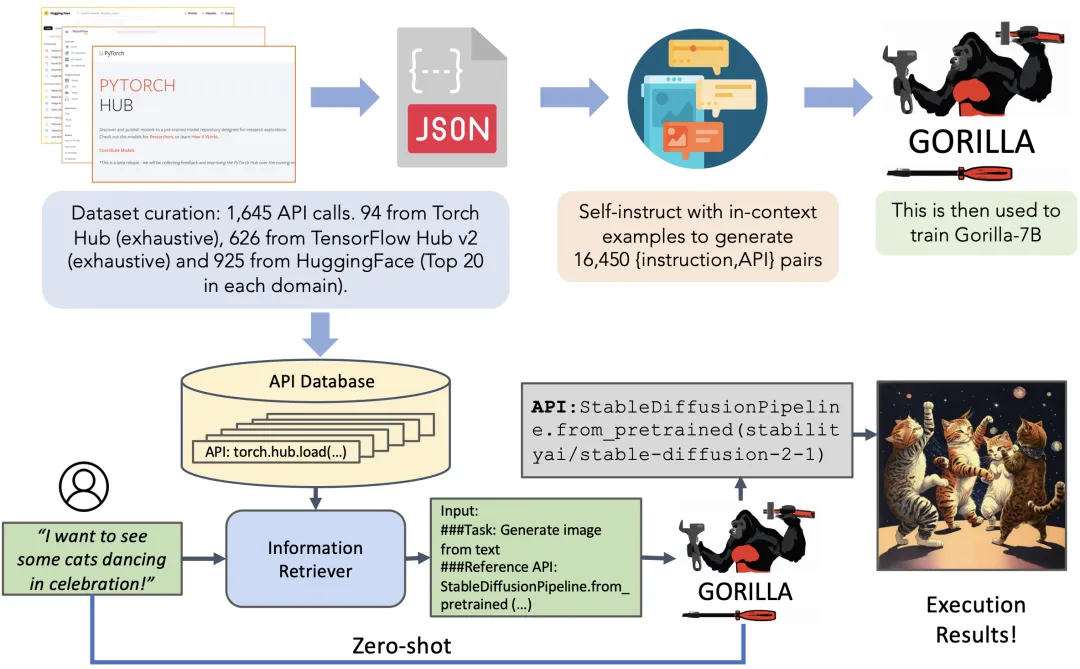

ToolFormer等文章为大家展现了一个语言模型和工具互动的范例,但其实用的工具非常局限。来自加州大学伯克利分校人工智能实验室(BAIR)和微软研究院的研究者们提出了一个和 1600+ API互动的语言模型:Gorilla。该模型基于 LLaMA 进行微调,能根据用户输入的自然语言为用户选择合适的 API 来执行对应任务。理论上讲,这个模型可以根据用户需求调用其它各种 AI 模型,因此 Gorilla 有望成为一个统御其它 AI 的 AI 模型。

为了评估模型的能力,研究者们还推出了 APIBench。这是一个包含 HuggingFace、TorchHub 和 TensorHub API 的全面数据集。而 Gorilla 在 HuggingFace,Tensor Hub 和 Torch Hub 上的表现都超过了 GPT-4,在很大程度上也减少了语言模型的幻想,能更准确的使用 API。

Gorilla:https://github.com/ShishirPatil/gorilla/

7月26日上午10点,Gorilla 一作、加州大学伯克利分校人工智能实验室(BAIR)在读博士张天均,将围绕主题《Gorilla:链接海量API的大型语言模型》对 Gorilla 进行深度讲解。

第四讲

主 题

《Gorilla:链接海量API的大型语言模型》

提 纲

1、LLM 与 API 交互的研究

2、LLM 调用 API 和 Service 的局限性

3、针对 API 调用任务微调的 LLaMA-7B 模型: Gorilla

4、在TorchHub、TensorHub 和 HuggingFace 上的应用表现

主 讲 人

张天均,加州大学伯克利分校人工智能实验室(BAIR)在读博士;导师是joseph gonzalez教授;研究方向主要涉及强化学习以及强化学习在语言模型/多模态模型中的应用;和sergey levine教授、pieter abbeel教授、denny zhou博士以及yuandong tian博士都有深度合作;曾在Meta AI Research和Google Brain实习,近期的研究主要集中于基于语言模型的自动化。

直 播 时 间

7月26日10:00