芯东西(ID:aichip001)

文 | 心缘

不知是否疫情使然,相较去年人工智能(AI)芯片领域热火朝天的发布潮,从今年开年至今,鲜少有国内AI芯片玩家发布新产品。

而谈及AI芯片,人们也不再局限于只看峰值性能和最大功耗,关注重心逐渐回归到需求本身:能落地哪些场景?好不好用?使用寿命有多长?物理成本够不够低?……

这些问题对应芯片的特性,可总结为几个关键词:算力性价比、架构通用性、软件易用性。

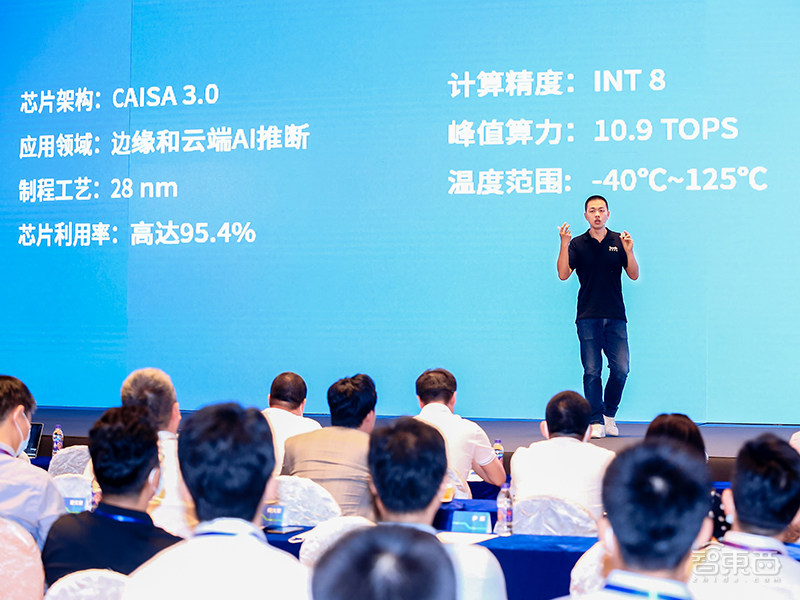

就在昨天,6月23日,一家深圳AI芯片创企鲲云科技推出其首款数据流AI芯片CAISA,在这三个特性上均有出色的表现。

CAISA芯片是面向边缘和云端高性能AI推理芯片,已量产,峰值性能达10.9TOPS,有良好的通用性和易用的软件工具链,并且芯片利用率最高可达95.4%,较同类产品提升了10倍,也就意味着更高的算力性价比。

根据中国人工智能产业发展联盟(AIIA)的数据,CAISA芯片仅用1/3的峰值算力,即可实现英伟达同类产品(NVIDIA T4)最高3.91倍的实测性能。

相比之下,有些芯片尽管理论峰值算力很高,但在实际应用中不能将算力完全发挥出来,实测算力还不到峰值算力的1/3。

同时,基于CAISA芯片的星空X3加速卡已在智慧城市、智慧制造、安监生产、轨道交通、智能遥感等领域均有落地。

那么鲲云科技是如何突破传统芯片架构对芯片利用率的约束呢?又如何做到帮用户省钱呢?

这源自鲲云选择了一条截然不同的路线。

一、从帝国理工学院走出的创业新秀

2010年,从复旦大学电子工程系毕业后,23岁的牛昕宇前赴英国帝国理工学院继续深造,师从帝国理工学院教授、英国皇家科学院院士、IEEE会士、BCS会士陆永青(Wayne Luk)。

陆永青是全球定制计算领域赫赫有名的学术大牛,也是全球AI芯片领域唯一一位英国皇家科学院、英国工程学会、英国计算机学会的三院院士。

定制计算从用户具体应用的需求出发,通过软硬件协同的设计工具,以定制处理器的形式来适配应用需求,从而在同等硅片面积上实现更高的计算性能。

在帝国理工学院求学的旅程中,牛昕宇曾拿下全奖博士,并成为学院最年轻的助理研究员,学术旅程星光熠熠,已准备前往斯坦福大学做博士后。

但五年前的一次回国之旅,改变了牛昕宇的人生规划。

▲鲲云科技CEO牛昕宇博士

▲鲲云科技CEO牛昕宇博士

2015年,牛昕宇回国参加一个技术论坛做演讲,演讲结束后,有投资人找上门邀请他回国创业。

在陆永青院士的支持下,2016年1月,牛昕宇博士和陆永青院士回国联合创立AI芯片公司鲲云科技(Corerain Technologies),公司名取自《逍遥游》,希望公司有朝一日能“扶摇直上九万里”,成长为一家拥有自主知识产权、技术领先的AI芯片公司。

▲鲲云科技首席科学家陆永青院士

▲鲲云科技首席科学家陆永青院士

牛昕宇博士任鲲云科技CEO,陆永青院士则在鲲云任首席科学家。

除了这二位创始人外,鲲云早期团队的绝大多数成员均来自帝国理工学院,例如鲲云的另一位联合创始人CTO蔡权雄是帝国理工学院的博士后。

创立之初,鲲云科技已经意识到AI芯片与算法、应用密切联系,决定提供垂直领域的全套硬件解决方案,既基于自研AI芯片提供一体化计算平台设备,也提供与CAISA芯片配套的领域落地解决方案,大幅降低鲲云计算平台落地门槛与使用难度。

尽管成立时间只有短短四年,鲲云在商业落地方面已屡有成果。其明星产品“星空”加速卡已在航天航空、卫星遥感、电力、教育、工业检测、智慧城市等多个领域落地。

去年6月,鲲云科技成为英特尔全球旗舰FPGA合作伙伴,并与浪潮信息达成元脑计划战略合作,在AI计算加速方面开展深入合作。

出于培养人才的考虑,鲲云还于2018年创立人工智能创新应用研究院。

除与英特尔合作进行人工智能课程培训外,鲲云人工智能创新应用研究院和帝国理工学院、哈尔滨工业大学、北京航空航天大学、天津大学等国内外高校成立了联合实验室,在定制计算、AI芯片安全、工业智能等领域开展前沿研究合作。

在这一系列落地产品、解决方案和基础研究的背后,核心技术基础即是鲲云科技自研的定制数据流架构。

二、首款量产数据流AI芯片,突破芯片利用率限制

基于陆永青院士深耕近三十年的数据流定制计算技术,鲲云科技自主研发了一种新型AI芯片架构——定制数据流架构(Custom AI Streaming Accelerator,CAISA)。

计算架构在持续演进,每一次计算架构的重大创新都代表一个新的算力时代。

从x86到RISC计算平台,能效比提升10倍以上;从x86到CUDA计算平台,峰值算力又提升10倍有余……从历史脉络来看,新的算力平台需相对上一代主流算力平台在某个指标上高出逾10倍,才能实现实测性能的大幅提升。

在鲲云看来,下一代有望带来10倍以上突破的AI芯片指标即是芯片利用率。

鲲云研发的CAISA架构,通过多引擎并行的计算方式,突破传统指令集架构的技术限制,能在同等峰值算力条件下,在芯片利用率指标上实现10倍的提升。

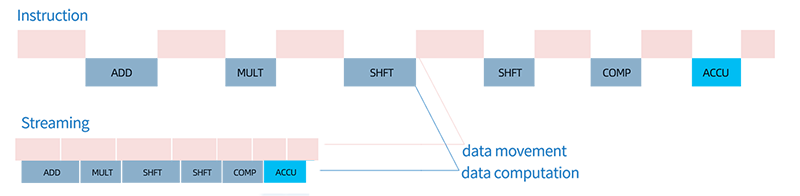

传统指令集架构采用冯诺依曼计算方式,通过指令执行次序控制计算顺序,并通过分离数据搬运与数据计算提供计算通用性。

▲基于冯诺依曼的典型指令集架构示意图

▲基于冯诺依曼的典型指令集架构示意图

在实际架构中,指令集架构中的芯片计算单元在大部分时间都处于闲置状态,所发挥的性能远低于芯片峰值算力。

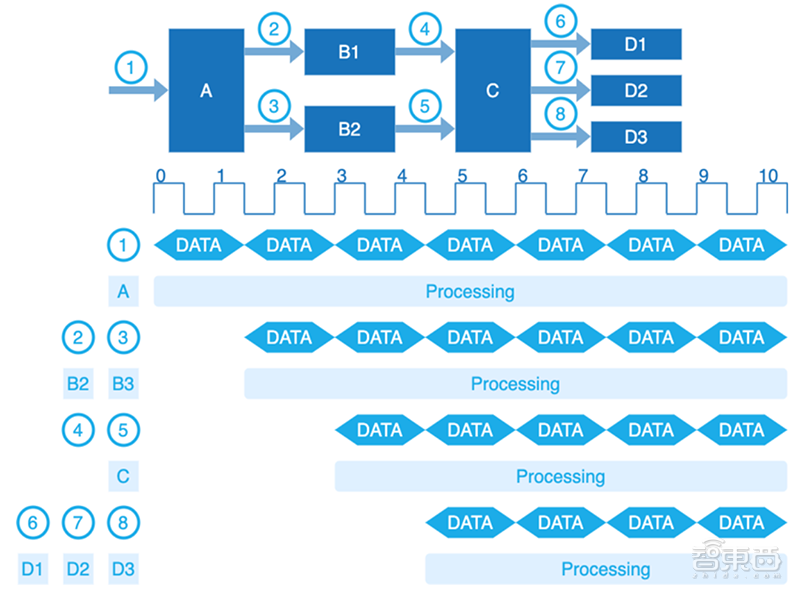

与之不同的是,数据流架构没有指令集,完全依托于数据流的流动次序控制计算执行次序,消除了因指令控制和数据搬运等因素产生的数据开销,大幅降低计算单元闲置。

▲指令集架构与数据流架构在数据流动和计算顺序上的区别

▲指令集架构与数据流架构在数据流动和计算顺序上的区别

与其他架构的AI计算平台相似,定制数据流架构同样面临三个核心挑战:

(1)算力性价比:用户单位价格能够买到的 AI 算力,越高越好,即在保证计算准确率的前提下,实现芯片利用率的持续提升;

(2)架构通用性:架构对于不同 AI 算法的支持,支持的算法越多越好,这与定制数据流架构深度定制的特性相悖;

(3)软件易用性:AI 算法迁移至新平台的支持程度,越易用,迁移成本越低越好,这可能与定制数据流架构精细底层控制的特性相悖。

鲲云科技的CAISA架构即通过时钟精确计算、流水线动态重组、算法端到端自动化部署这三项核心技术,成功破解了上述三大难题。(我们将在下一节更详细地介绍这三项技术。)

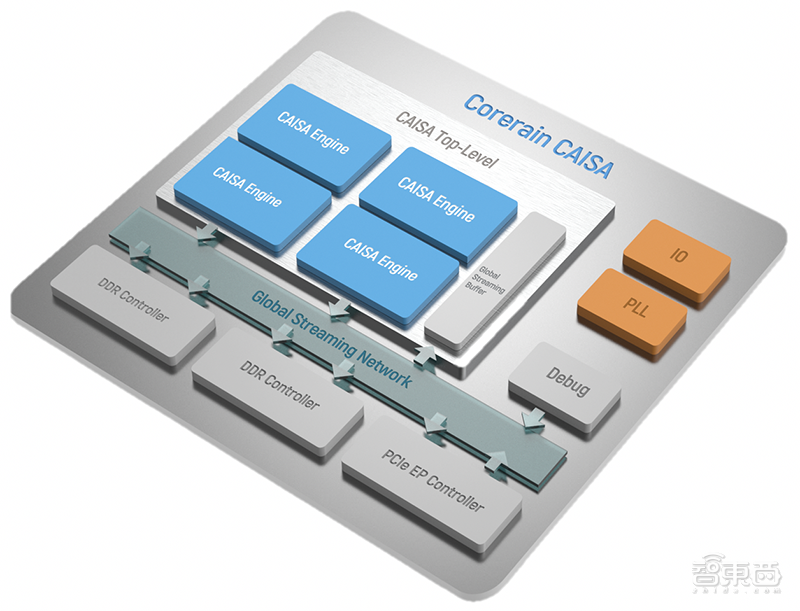

▲CAISA芯片架构图

▲CAISA芯片架构图

当前CAISA架构已经升级到3.0版本。昨日新发布的CAISA芯片搭载了4个CAISA3.0引擎。

该芯片被设计为协加速器,采用28nm工艺,具有超过1.6万个乘累加单元,峰值性能可达10.9TOPS,已完成全面验证并已量产。

CAISA芯片通过PCIe Gen3接口与主处理器通信,通过PCIe通道,处理器能以32Gbps的吞吐量将数据传输到芯片中;同时有双DDR4通道,支持大容量设备侧本地存储器,可为每个CAISA引擎提供超过340Gbps的带宽。

同时,CAISA芯片的温度范围较宽,-40-125度,包括其他器件都是专门按照工业级的质量、温度、电池要求来设计。

三、CAISA升级3.0,完成三大技术突破

相较上一代架构,CAISA3.0在架构效率、实测性能、算子支持等方面均有明显提升,支持绝大多数神经网络模型快速实现检测、分类和语义分割部署,并在多引擎支持上提供了4倍更高的并行度选择,架构的可拓展性大大提高。

在AI芯片内,每一个CAISA都可同时处理AI工作负载,进一步提升了CAISA架构的性能,在峰值算力提升6倍的同时,保持了高达95.4%的芯片利用率,实测性能线性提升。

同时,CAISA3.0架构对编译器RainBuilder更加友好,软硬件协作进一步优化,在系统级别上提供更好的端到端性能,在提供高算力的同时,可无缝链接Caffe、TensorFlow及ONNX等多种主流框架,并支持VGG、ResNet、YOLO等多种算法模型。

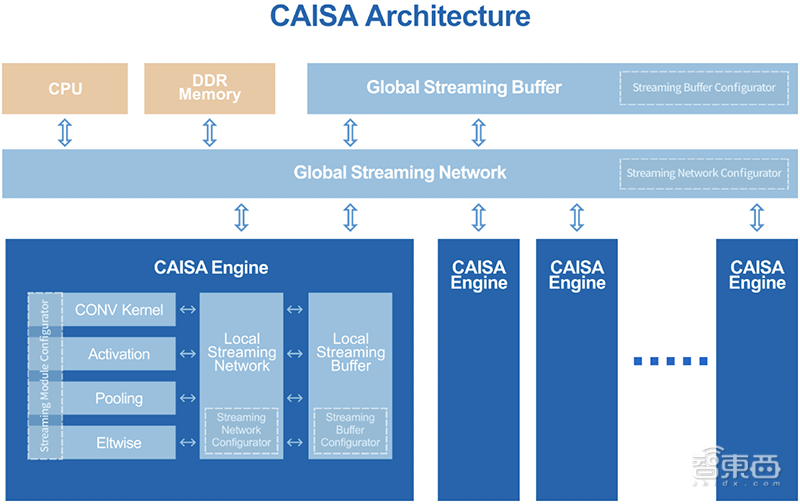

▲CAISA 3.0架构图

▲CAISA 3.0架构图

具体来说,鲲云CAISA3.0架构的三大技术突破主要通过以下方式实现:

1、时钟精确计算:提供最优算力性价比

CAISA3.0架构由数据流来驱动计算过程,无指令操作,可实现时钟级准确的计算,最大限度的减少硬件计算资源的空闲时间。

在保持计算正确前提下,CAISA3.0架构通过数据计算与数据流动的重叠,压缩计算资源的每一个空闲时钟,推高芯片实测性能以接近芯片物理极限,让芯片内的每个时钟、每个计算单元都在执行有效计算。

▲数据流动与数据计算重叠示意图

▲数据流动与数据计算重叠示意图

该架构通过算力资源的动态平衡,消除流水线的性能瓶颈;通过数据流的时空映射,最大化复用芯片内的数据流带宽,减少对外部存储带宽的需求。

上述设计使CNN算法的计算数据在CAISA3.0内可以实现不间断的持续运算,最高可实现95.4%的芯片利用率;在同等峰值算力条件下,实测算力可超出同类GPU的3倍以上的实测算力,从而为用户提供更高的算力性价比。

2、流水线动态重组:高架构通用性

CAISA3.0架构通过流水线动态重组,实现对不同深度学习算法的高性能支持。

通过CAISA架构层的数据流引擎、全局数据流网、全局数据流缓存,以及数据流引擎内部的人工智能算子模块、局部数据流网、局部数据流缓存的分层设计,在数据流配置器控制下,CAISA架构中的数据流连接关系和运行状态都可以被自动化动态配置,从而生成面向不同AI算法的高性能定制化流水线。

在每个CAISA流水线中,不同数据流模块所提供的计算吞吐率不同。为进一步提升芯片利用率,CAISA架构支持不同数据流模块间以串行和并行的方式互联,以平衡不同模块的吞吐率差异,实现流水线性能的最大化。

因此,CAISA3.0架构能在保证运行每个算法能实现高芯片利用率的同时,通用支持如目标检测、分类及语义分割等所有主流CNN算法。

3、算法端到端自动化部署:高软件易用性

软件易用性也是AI计算平台的核心性能之一。以基于CAISA3.0架构的单颗CAISA芯片为例,其中包含了接近2万个数据流计算模块。

而要在CAISA芯片内部高效支持一个AI算法运算,需要准确配置2万个数据库模块、所有数据流网络以及数据流缓存的时钟级精确运行状态。假若没有有效的软件支持,CAISA架构将非常难用。

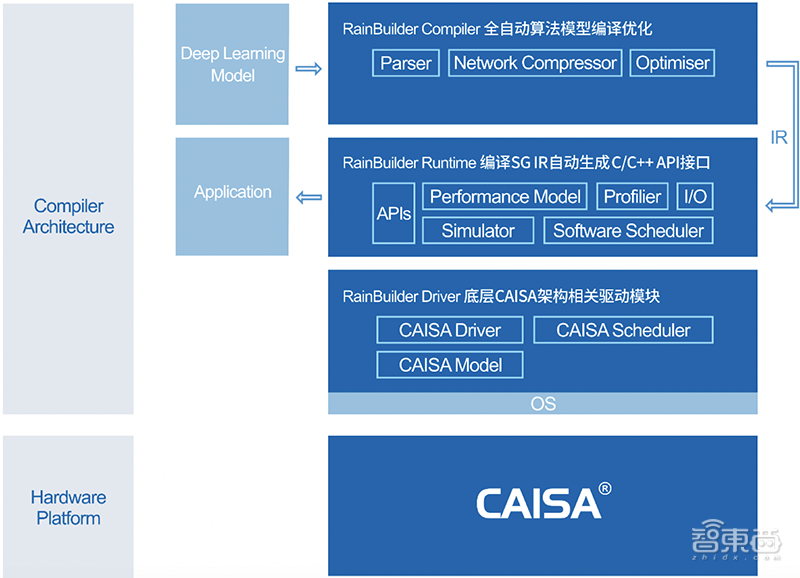

对此,鲲云科技打造了专为CAISA定制的软件工具——RainBuilder自动编译工具链,可实现算法端到端的推理模型自动部署。

▲RainBuilder编译工具链

▲RainBuilder编译工具链

RainBuilder编译器可自动提取主流AI开发框架中开发的深度学习算法的网络结构和参数信息,并面向CAISA架构进行优化;运行时和驱动模块负责硬件管理并为用户提供标准的API接口,运行时可实现算法向CAISA架构的自动化映射,同时提供可以被高级语言直接调用的API接口;最底层的驱动可以实现对用户透明的硬件控制。

借助RainBuilder工具,用户无需底层数据流架构背景支持,简单两步,几行指令,即可实现快速且低成本的算法迁移和部署,有效降低使用门槛。

四、发布两款加速卡,芯片利用率超英伟达T4

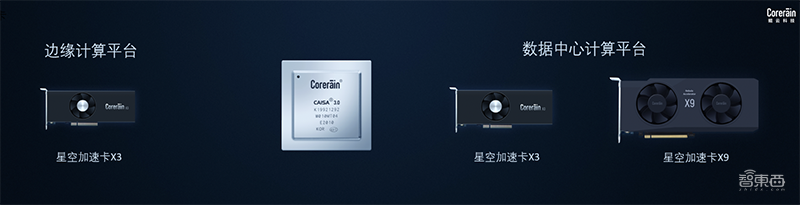

在发布最新CAISA芯片的同时,鲲云科技也发布了基于CAISA芯片的星空系列边缘和数据中心计算平台——X3加速卡和X9加速卡。

不仅如此,鲲云科技还现场一并公布了由中国人工智能产业发展联盟(AIIA)测试的包括ResNet-50、YOLO v3等在内的主流深度学习网络的实测性能。此举在国内AI芯片发布会中相当少见。

星空X3加速卡是搭载单颗CAISA芯片的数据流架构深度学习推断计算平台,为工业级半高半长单槽规格的PCIe板卡,已在智慧城市、智慧制造、安监生产、轨道交通、智能遥感领域均有落地。

得益于其轻量化的规格特点,X3加速卡可与不同类型的计算机设备进行适配,包括PC、工业计算机、网络视频录像机、工作站、服务器等,满足边缘和高性能场景中的AI计算需求。

本次公布的benchmark网络涵盖了分类、检测和语义分割等深度学习领域三个主要的应用类型。Benchmark显示,所有在星空X3上测试运行的网络均可达65%以上的实测芯片利用率。

相较于英伟达边缘端旗舰产品Xavier,星空X3可实现1.48-4.12倍的实测性能提升。

星空X9加速卡为搭载4颗CAISA芯片的深度学习推断板卡,峰值性能43.6TOPS,主要满足高性能场景下的AI计算需求。

与英伟达AI推理旗舰产品T4相比,星空X9在ResNet-50、YOLO v3等模型上的芯片利用率提升2.84-11.64倍。

在实测性能方面,星空X9在ResNet50可达5240FPS,与T4性能接近,在YOLO v3、UNet Industrial等检测分割网络,实测性能相较T4有1.83-3.91倍性能提升。

在达到最优实测性能下,星空X9处理延时相比于T4降低1.83-32倍。

目前星空X3加速卡已量产,星空X9加速卡将于今年8月上市。

五、AI算法规模越大,CAISA芯片利用率越高

会后,鲲云科技创始人兼CEO牛昕宇博士、鲲云科技合伙人兼COO王少军博士、鲲云科技合伙人兼CTO蔡权雄博士、鲲云科技合伙人兼研发总监熊超博士等高管向媒体谈到更多芯片背后的细节。

▲从左到右依次为鲲云科技COO王少军博士、CEO牛昕宇博士、CTO蔡权雄博士、研发总监熊超博士

▲从左到右依次为鲲云科技COO王少军博士、CEO牛昕宇博士、CTO蔡权雄博士、研发总监熊超博士

相较其他从事数据流AI芯片技术路线的公司,如Wave Computing和Groq等,蔡权雄博士认为:“鲲云是真正可以商业的第一家。”

蔡权雄博士说,鲲云的团队已在数据流领域积累了三十年,趟过了很多坑,在工程上有很多很辛苦的突破,个中辛苦远没有PPT上写得这么好看。“我们做了很多底层很累的工作,这些工作才是整个芯片能真正流片成功、真正商业化、落地化的基石。”

此前CAISA 1.0、2.0架构均部署在FPGA上,这是因为鲲云一方面需要快速将产品推向市场并得到用户的反馈,另一方面在没有确定有大量商业订单的情况下以更低的成本让产品快速满足客户需求。

“当你的需求量到达一定量级时,一定会从FPGA切换成ASIC, 这是芯片实现方式的区别。”牛昕宇博士说,“ASIC相对于FPGA可以提高更高的峰值算力、更低的功耗、更低的成本。这样它本身的性能就会得到大幅提升。”

在他看来,如果希望国内有AI芯片企业能够引领AI行业的发展,那一定依靠的是它能给所有AI从业者创造真真正正的价值。

牛昕宇博士强调:“这个价值,从买每一颗鲲云的芯片,都能够帮用户省钱,都能够在每一个领域场景中提供更好的性能、更低的延时、更好的落地效果来落地。”

由于CAISA芯片主要针对int8精度做AI推理运算,相比FP32会有一定精度损失。

对此,牛昕宇博士介绍道,int8精度影响很小,鲲云CAISA的精度损失与TensorRT的精度损失基本一致,鲲云后续还会提供再训练的方式,将精度进一步补回来。

另外他也提到,因为公司发展处于初期阶段,现阶段会专注于AI推理芯片。

熊超博士补充说,基于现有测试,int8计算的精度损失维持在0.5%内,通过量化再训练过程,在绝大多数的模型中可做到将精度完全恢复,和原始FP32的结果误差非常小,各大AI芯片厂商均在往int8量化方向上走。

如今AI模型越变越大,更适宜CAISA芯片发挥更高的实测算力。

“可以看到,对于同类的网络,比如ResNet50和ResNet152,ResNet152的芯片利用率是更高的,达到95.4%,”牛昕宇博士解释说,“这是由于数据流的特性所决定:越大的网络,流水线越深,所能发挥的实测算力越大。”

在落地方面,据王少军博士透露,鲲云的X3加速卡已在一些大客户内部做了实测,总体反馈非常好,算力性价比、芯片利用率、低延时效果、对算子支持、软件易用性等指标的提升均已得到验证。

从市场推广角度来说,王少军博士提到,鲲云不仅与艾睿、骏龙、神马、WPI等代理商保持着良好的合作关系,而且自己的AE团队和售后团队均在持续成长。由于鲲云更多的市场面向国内,对客户可提供更好的本地化支持。

“商业上,我们会一个领域一个领域做,跟更多合作伙伴推进落地。”牛昕宇博士说,“我们了解这些领域落地的需求,根据这些做出更多产品,来满足客户的要求。这是我们长期迭代的商用方向。”

结语:AI芯片到了拼落地的时刻

图灵奖得主、计算机体系结构宗师David Patterson与John Hennessy曾于去年预告,未来十年将是计算机体系架构的黄金十年。

新的架构优化和提升正如雨后春笋般不断涌现,通过软件与硬件的结合,我们看到算力还在持续的增长甚至革新。

对于芯片研发者而言,AI的蓬勃发展无疑创造了一个新的绝佳创新和创业时期,是以过去数年间,国内外涌现出一大批AI芯片创业公司,纷纷探索不同技术路径来满足各类AI算法和应用场景对算力的需求。

但面对巨头及同类初创公司的竞争,AI芯片创企们也承受着着巨大的生存压力,如何以成熟高效且高性价比的产品组合赢得客户的信任,是每个芯片创企都要做的功课。

从实测性能以及处理延时的领先数据来看,鲲云首款基于自研数据流架构的CAISA芯片表现令人惊喜,从实际落地的性能需求出发,为AI芯片的发展提供了一条新的技术路线。

与此同时,伴随AI芯片投资热潮的消减,单凭创新的想法很难吸引到大量的资本,有能力落地和盈利的AI芯片公司才有望长久地生存下去,鲲云科技看起来正是其中之一。