芯东西(公众号:aichip001)

作者 | 程茜

编辑 | 漠影

2023年,毫无疑问是算力需求大爆发的转折之年,如今随着国内两批超20个大模型获得审批、种类多样的大模型相关应用显现,企业对私有化部署的需求也水涨船高。

面向这一行业趋势,2023年世界互联网大会乌镇峰会上,国内云端RISC-V大芯片创企希姆计算就联合国鑫发布了基于开源指令架构RISC-V打造的大模型系列一体机。其中包括2U4卡、4U8卡机,支持部署6B、7B、13B参数规模的大模型,这也是专门针对私有化部署提供的系统级解决方案。

在私有的处理器指令集Arm和x86之外,希姆计算的产品为满足市场算力需求提供了在用户高并发、技术自主可控方面具有优势的新选择。

AI大模型在推理侧的新机遇与RISC-V创新架构具有的可扩展性、可编程性、超大规模等优势特点不谋而合。

技术和场景应用的双重优势下,希姆计算的大模型一体机能支撑企业将基座模型进行大规模部署。

从希姆计算的大模型一体机出发,芯东西与希姆计算副总裁姚金鑫进行了深入交流,探讨了大模型产业发展至今产生的显著变化,以及专注于RISC-V架构的希姆计算在其中扮演的角色。

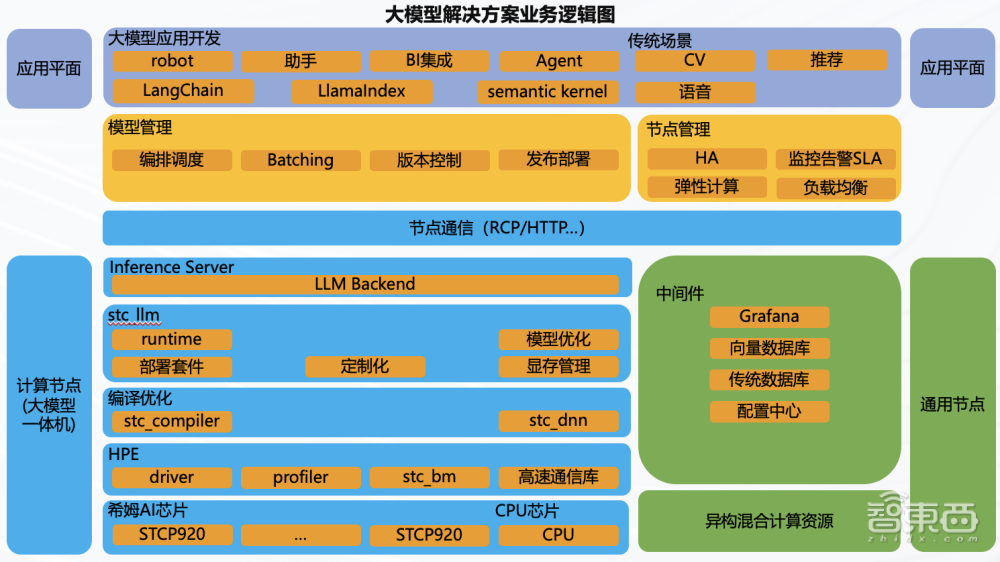

可以看出,大模型私有化商业部署的关键是对数据安全,算力自主可控以及部署成本的苛刻要求,RISC-V架构本身的开源、灵活等特性,以及希姆计算联合生态伙伴共同打造的软硬一体国产化方案,成为企业规模化部署大模型的坚实基础。

一、大模型焦点转向推理侧,催生AI芯片创企新机遇

去年11月底,聊天机器人ChatGPT横空出世,催生了新一轮的技术创新。到今天,大模型的热度仍然不减,对于国内AI芯片企业而言,姚金鑫最大的感触之一就是,算力需求正无限扩张,并且看不到需求的上限。

毫无疑问,AI芯片“一哥”英伟达依靠自身的技术,供应链资源以及生态优势在训练领域一骑绝尘,国内AI芯片厂家结合目前的商业环境,看到了新的市场机遇——大模型推理。

姚金鑫谈道,今年前三个季度产业聚焦于训练,现在一些面向消费者、垂直场景的大模型应用出现,接下来就是“基座模型向细分应用场景的切入,其中重要的计算就是Fine-tuning(微调)和推理”。

据了解,百度、字节跳动、商汤、百川智能、智谱华章、蚂蚁等超20个大模型通过备案,开始正式对外提供服务,相关应用产品也相继发布,这都使得产业的焦点正在从大模型训练扩展到规模化推理部署。

从算力层面来看,大模型训练和推理平台的侧重点不同。训练平台的特点是大集群、高集中度、高性能,姚金鑫解释说,训练任务对芯片本身的算力、内存大小、带宽、片间互联以及网络层面的技术要求都很高,这与模型本身的参数规模、训练数据相关,而且直接影响大模型训练效率以及迭代速度。

放到推理侧来看,其重点在于关注单机甚至单卡在算力,内存容量和带宽,卡间互联能力上面的要求,还有一个更为关键的点在于,需要结合软硬件一体从系统层面提升计算效率以支持尽可能多的并发用户。

也就是说,训练对算力的需求一定程度上取决于模型的大小,并且追求的是高性能和高稳定性,推理不仅要考虑模型的大小还需要考虑用户的数量,侧重于实现同时并发,其对算力的需求更多体现在计算效率和规模上。

值得一提的是,当下受地缘政治影响,国内半导体产业发展受限,开源、高效、成本低的RISC-V指令集架构也成为解决国内大模型落地算力需求的有效技术路径。

这些新的变化都为基于RISC-V技术线路做数据中心芯片的希姆计算展现出新的市场机会。

二、系列一体机设备落地,场景私有化本地部署策略解析

希姆计算联合国鑫推出的一系列针对大模型推理场景的一体机,就是这家创企在新产业变革下追逐产业机遇的有力探索。

2023年世界互联网大会乌镇峰会上,希姆计算正式对外发布了4U8卡一体机,此外还包括2U4卡一体机,这都是其针对私有化部署提供的系统级解决方案。

希姆STCP920系列采用12nm工艺,是基于RISC-V的人工智能计算加速卡,具备较高的云端AI计算能效比和可编程性,混合支持FP16/INT8数据类型。

希姆计算将其在传统AI场景里的方案针对大模型进行了专门的优化,姚金鑫坦言,这一一体机的劣势在于内存规格较小、带宽较窄,这也限制了其部署千亿级别模型需要多卡部署,再加上多卡之间通过PCIe和CPU之间的传输,会影响性能。

但是由于STCP920研发较早,已经实现大规模量产商用,而且供应链未受限制其优势在如今的大模型推理场景下也更为显著。他补充说,目前一体机可以单卡部署7B、13B参数规模的模型,并支持高强度的用户并发。

此外,希姆计算还正在研发机头+AI Box的产品,打造这一产品的目的为,使得标准机柜可以容纳更高的算力,同时支持更高的用户并发。

目前,希姆计算以7B、13B参数规模的Llama 2为基座模型打造了一系列解决方案,主要面向的就是私有化部署场景。

三、RISC-V架构三大优势,直指大模型推理场景

成立于2019年的希姆计算,是国内最早基于RISC-V做数据中心芯片设计的企业,据了解,其产品已经实现了在头部互联网巨头的批量商业落地。

截至目前,希姆计算已经完成7轮融资,投资方包括中国互联网投资基金、建银国际、中银国际等国家队投资机构,以及广州市产投基金等地方引导性基金。

精简指令集架构RISC-V正在凭借其开放开源的核心特点迅猛发展。据了解,2019年12月至今,RISC-V国际基金会的会员数已经从435个增加到将近4000个。

RISC-V对于AI计算的支持可以较好平衡高性能效率和高可编程性、高通用性,再加上其核心技术的开源开放、生态格局的逐渐成熟,逐步展现出强大的优势和演进迭代空间。我们看到Meta的AI加速芯片和谷歌的下一代TPU都采用RISC-V指令集架构。

除了架构本身优势外,姚金鑫谈道,团队当时还看到了数据中心对于AI计算需求的急速增长。这也奠定了希姆计算的发展方向。

RISC-V具有的可扩展性、可编程性和超大规模特性与大模型推理有着天然契合度。

RISC-V的优势之一是可扩展性,可以针对计算负载进行定制和优化,具体就AI计算而言,就是根据AI应用的需求,通过扩展指令提高执行计算任务的效率。这对于在确定的工艺制程下面提升性能至关重要。

姚金鑫补充说,事实上,RISC-V指令集的DSA架构除了可以通过扩充算力、加大内存容量与带宽来提高计算性能规格以外,还由于其具备良好的可编程性,可以更加快速地适配各类不同参数的大模型,针对新衍生的不同模型结构、算子实现快速优化升级。

除此以外,为了适应大模型推理的需求,希姆计算还从系统层面进行提升,通过服务器设计支持更多的用户并发。姚金鑫谈道,针对推理场景除了优化计算卡性能外,希姆计算还通过提升机柜下容纳的算力密度来支持更多的并发用户数。这在最新禁令限制芯片算力密度的情形下,显得尤为重要。

作为芯片设计企业,希姆计算提供给客户的产品除了芯片还有软硬件系统,因此面向推理场景该公司也实现了系统级交付。诸如产业园区智能化展示场景、校园管理的学工服务、法务领域的文本处理等领域。

2019年至今,希姆计算在CV(计算机视觉)、NLP(自然语言处理)等领域都有丰富的场景应用积累,对于芯片稳定性的不断完善和优化,为支持大模型私有化部署奠定了坚实的基础。

除了技术路线演进外,RISC-V开源社区的工作也在稳步推进。据了解,希姆计算是国际上最早开源RISC-V AI扩展指令的团队。同时,希姆计算作为RISC-V国际基金会董事单位,也正在全力推进自研AI扩展指令的国际标准化工作。

可以看出,想要抓住产业机遇,具体的技术开发和工程实践积累才是重中之重。

结语:瞄准大模型推理场景,探索RISC-V结构新解法

大模型产业浪潮轰轰烈烈蔓延至今,越来越多的企业、人才、资本都聚焦于此,又因为算力作为大模型重要的底座,国内AI芯片企业更是处于风口浪尖的存在。想要快速抓住机遇,除了强大的执行力外,更离不开企业的技术积累与布局。

如今大模型推理侧爆发出新的机遇,最早入局基于RISC-V架构打造数据中心芯片的希姆计算,看到了AI推理侧暴发出的新市场机遇,从而基于多年来在AI行业与芯片行业的布局与深耕,迅速掏出系列解决方案从而满足其背后的算力需求。希姆计算正在从私有化本地部署推进,在大模型带来的产业变革下,热切寻找市场机遇。

可以看出,想要抓住产业机遇,具体的技术开发和工程实践积累才是重中之重。